نحوه نوشتن پرامپت مؤثر برای ChatGPT

آموزش تکنیکهای نوشتن دستورات مؤثر برای دریافت بهترین پاسخ از مدلهای زبانی

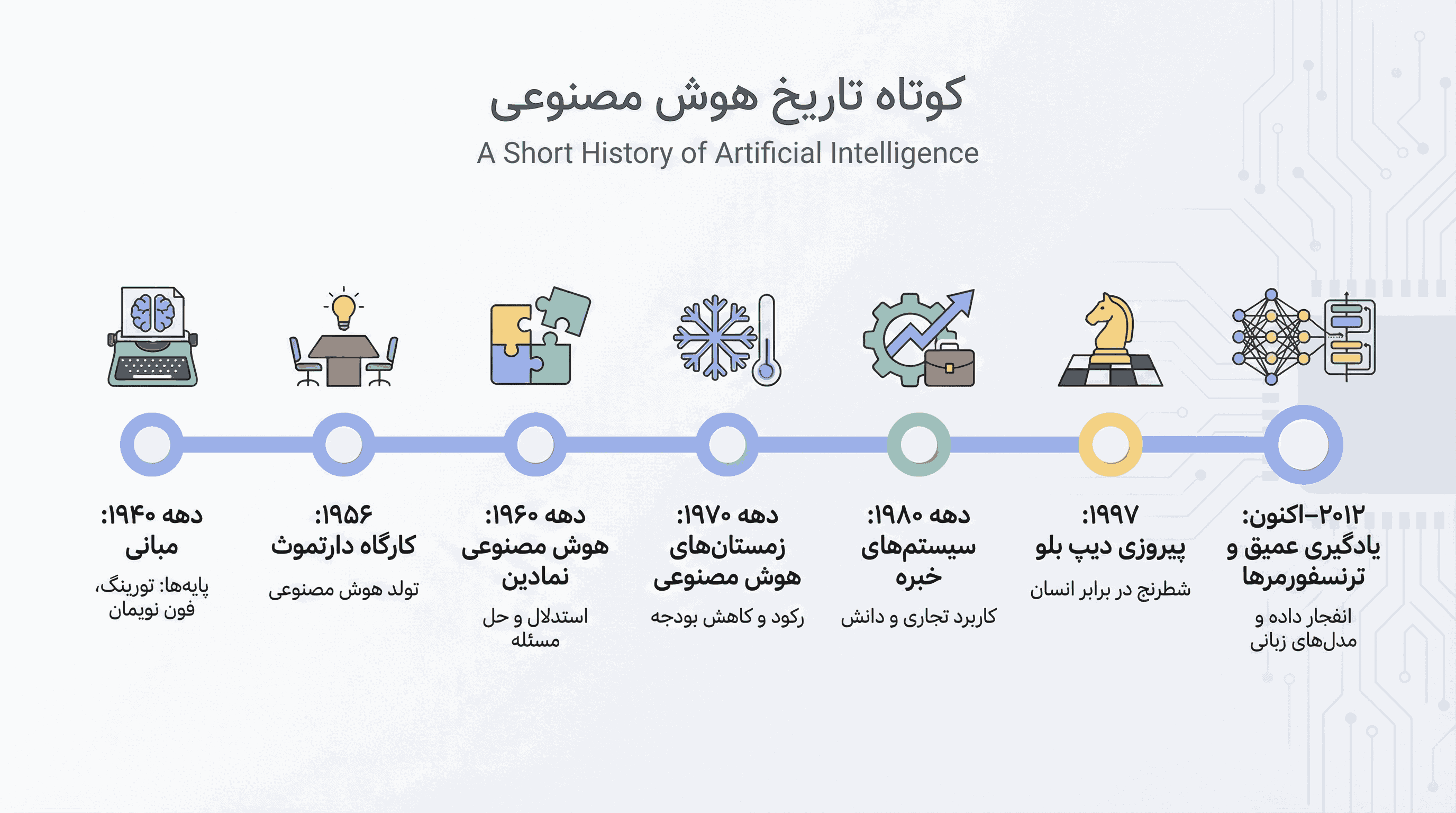

در این مقالهٔ کوتاه و ساده، مسیرِ رشدِ AI را با نقاط عطفِ کلیدی مرور میکنیم — طوری که برای خوانندهٔ غیرمتخصص هم روشن و جذاب باشد.

ایدهٔ اینکه ماشینها «میتوانند فکر کنند» قبل از وجودِ کامپیوترهای امروزی هم مطرح بود. ریاضیدانها و منطقدانها مانند آلن تورینگ دربارهٔ این سؤال فکر کردند: «آیا ماشینها میتوانند اندیشه کنند؟» (تست تورینگ، ۱۹۵۰). پس از جنگ جهانی دوم، معماریهای پایهٔ کامپیوتر توسط جان فون نویمَن شکل گرفت و بسترِ عملی برای اجرا کردن ایدهها فراهم شد.

جواب: نه؛ ابتدا بحثها نظری و مفهومی بودند و فقط با پیدایشِ کامپیوترهای الکترونیکی بود که پیادهسازی ممکن شد.

در تابستان ۱۹۵۶ گروهی از محققان در کنفرانسی در دارتموث (Dartmouth Workshop) گرد آمدند. آنجا رسماً عبارت «Artificial Intelligence» مطرح شد و زمینهٔ یک رشتهٔ تحقیقاتی شکل گرفت. دههٔ پنجاه را میتوان «عصرِ امکانپنداشتن» دانست: محققان فکر میکردند مشکلاتِ زیادی را میتوان با قوانین و منطق حل کرد.

نمونههای اولیه: برنامههایی که معادلات ریاضی حل میکردند یا بازی شطرنج را اجرا میکردند.

هوشِ نمادین (Symbolic AI) ایدهٔ غالب بود: حلِ مسئله با نمایشِ دانش بهصورت نمادها و قوانینِ دستنویس. سیستمهایی مانند Logic Theorist و SHRDLU نمونههایی از این دورهاند — برنامههایی که میتوانستند استدلالهای منطقی کنند یا دستورات سادهٔ زبان طبیعی را در محیطِ محدود اجرا نمایند.

ویژگی: تکیه بر قوانین انسانی و منطق صریح.

پس از انتظارهای بزرگ، واقعیت منابع و پیچیدگیِ مسائل مشخص شد: محدودیتِ سختافزار، کمبود داده و دشواریِ نوشتنِ قواعد برای تمام حالات. نتیجه دو دورهٔ «زمستانِ AI» بود — زمانی که سرمایه و علاقهٔ عمومی کاهش یافت و تحقیقات دوباره ارزیابی شدند.

جواب: چون مسائل واقعی پیچیدهتر از انتظارات بود و محققان مسیرهای جدید (مثلاً روشهای آماری) را بررسی کردند.

در دههٔ ۱۹۸۰، سیستمهای خبره (Expert Systems) مانند MYCIN در پزشکی ظهور کردند؛ این سیستمها بر پایهٔ قوانینِ بسیارِ دستنویس عمل کرده و در صنایع مختلف کاربرد تجاری یافتند. شرکتها و دولتها دوباره سرمایهگذاری کردند، اما این تکنیکها هم با چالشهای نگهداری قوانین و مقیاسپذیری روبرو بود.

با رشدِ اینترنت و ذخیرهٔ دیجیتالِ دادهها، گرایش به سمت روشهای آماری و یادگیریِ ماشین افزایش یافت. الگوریتمهای مبتنی بر احتمال، یادگیری از نمونهها و مدلهای سادهتر جایگاه خود را یافتند. نقطهٔ عطفی که اغلب به آن اشاره میشود پیروزیِ Deep Blue (سازمانِ IBM) بر قهرمان شطرنج گرهاسپفِ گاری کاسپارف در ۱۹۹۷ است — نشاندهندهٔ قدرتِ محاسباتی و الگوریتمیِ جدید.

در ۲۰۱۲ تیمِ دانشگاهِ تورنتو با شبکهٔ عصبی بهنام AlexNet در مسابقهٔ تشخیص تصویر (ImageNet) پیروز شد و فاصلهٔ زیادی با روشهای سابق ایجاد کرد. دو عامل کلیدی این موفقیتها بودند:

از آن زمان، مدلهای عمیق در تشخیص تصویر، گفتار، ترجمهٔ ماشینی و تولید متن پیشرفتهای چشمگیری داشتند. سالهای بعد، معماریهای جدیدی مثل ترنسفورمر (Transformer) در ۲۰۱۷ معرفی و مسیرِ مدلهای زبانی بزرگ (LLMs) را هموار کردند.

امروز AI فقط در آزمایشگاه نیست: در موبایل، جستجو، تشخیصِ پزشکی کمکی، خودروهای خودران و تولید محتوا حضور دارد. اما این رشد مسائل تازهای هم ایجاد کرده: سوگیری در دادهها، حفظ حریم خصوصی، اشتغالِ مشاغل خاص و نیاز به شفافیت در تصمیمگیریِ ماشینها.

جواب: نه دقیقاً؛ در کوتاهمدت بیشتر وظایف تکراری و بخشهایی از کارها اتومات میشوند، اما کارهای خلاقانه، مدیریتی و انسانی نیاز به همکاری انسان و ماشین دارند.

ج: در کنفرانس دارتموث در سال ۱۹۵۶.

ج: پیروزی AlexNet در مسابقهٔ ImageNet (۲۰۱۲) و سپس معرفی ترنسفورمر (۲۰۱۷).

ج: نه همیشه؛ بعضی روشهای نمادین یا الگوریتمهای ساده با دادهٔ کم هم کار میکنند، اما برای بسیاری از کاربردهای پیچیده دادهٔ زیاد مفید است.

تازهترین تحولات و رویدادهای حوزه هوش مصنوعی

معرفی ابزارهای هوش مصنوعی برای استفاده عملی

ادغام هوش مصنوعی در پلتفرم مدیریت پروژه و یادداشتبرداری برای بهبود بهرهوری

مشاهده جزییات